Pokroky ve strojovém učení přinášejí pozoruhodně absurdní situace. Nově třeba tu, že si pornoherečky stěžují na to, že lidé na internetu poškozují jejich důstojnost. A že v tom mají v zásadě pravdu. Stejně jako si oprávněně stěžují celebrity, jejichž tváře se objevují „příklepené“ na nahá těla těchto pornohereček.

Podívejte se na ukázky těchto montáží i vysvětlení (video: Technet.cz):

Jak je vidět, nejde jen o nějakou ledajakou fotomontáž. Po webu se šíří něco, čemu budeme prozatím říkat „amatérské videomontáže“. Někde je jejich faleš na první pohled patrná a video vypadá jako z hororu o zloději tváří. Jindy jsou ale výsledky až nečekaně realistické.

V posledních měsících totiž technologie, která umožní nahradit tváře, opustila laboratoře expertů na strojové učení, a vtrhla na internet přesně takovým způsobem, jaký vás jako první napadne. Když přijde na internetovou tvořivost, můžete si být jisti, že se brzy dostane za hranu...

Neuronová síť ve službách nadržených diskutérů

První falešné video tohoto typu, které si získalo pozornost širšího publika, zobrazovalo obličej herečky Gal Gadotové v pornografickém klipu. Zde je ukázka z pornografického klipu vlevo, zatímco vpravo vidíme obličej populární herečky. Přes obličej pornoherečky jej nasadil speciální počítačový program využívající prvky strojového učení.

Autor této videomontáže na serveru Reddit.com vystupoval pod přezdívkou deepfakes (jeho účet již není dostupný) a svým fanouškům vysvětlil, že klip vytvořil nikoli manuálně, ale chytrým využitím strojového učení. Vytrénoval neuronovou síť, která pak snímek po snímku nahradila původní tvář ve videu tváří herečky. Nejde přitom jen o nalepení nějaké konkrétní fotky, ale o generování zcela nové podoby herečky, kterou se neuronová sít „naučila“ z trénovacích dat.

Podobné klipy začaly zaplavovat internetová fóra v prosinci 2017. Brzy se kolem algoritmu uživatele „deepfakes“ zorganizovala komunita nadšenců. Některým šlo o technologii, jiným zjevně o pornografické splnění fantazií, výsledkem byla podivná symbióza pohánějící vznik nových, stále realističtějších montáží.

Ukázky videomontáží |

Někdo programoval, někdo ladil parametry učení neuronové sítě, někdo hledal obrázky celebrit pro toto trénování a někdo prostě využíval svých specifických schopností k vyhledávání pornohereček, jejichž tělo se „hodí“ k dané celebritě. Později dokonce komunita vyvinula samostatnou aplikaci, což otevřelo tvorbu videomontáží prakticky komukoliv, kdo měl chuť nebo choutky experimentovat.

Některé montáže jsou vtipné a nevinné, jako třeba ty, které nalepují obličej herce Nicholase Cage do všech možných filmů a klipů. Jedna z povedenějších deep fakes montáží třeba nasadila tvář Nicolase Cage herečce Amy Adamsové zpívající píseň „I Will Survive“.

Ukázka deepfakes:

Naprostá většina montáží sdílených v této Reddit skupině byla ovšem explicitně pornografického rázu. Diskuzní server Reddit proto posléze tento druh montáží zakázal, protože jde podle řady názorů o pornografii bez souhlasu. V době výmazu (na začátku února) měla komunita „deepfakes“ necelých sto tisíc odběratelů.

„Reddit měl v minulosti pravidlo proti nedobrovolné pornografii a sexuálně explicitním záběrům nezletilých. Sedmého února 2018 jsme toto pravidlo rozdělili do dvou samostatných pravidel,“ uvedl Reddit pro Motherboard. Reddit tak zakázal nejprve skupinu deepfakes obsahující pornografické montáže, později i samotnou diskuzi o technice těchto montáží.

Podobný krok učinily i některé další diskuzní, sdílecí a pornografické servery. Kromě nesporných etických problémů totiž tyto videomontáže pravděpodobně porušují autorská práva, a to jak práva pornohereček, tak práva celebrit, jejichž fotky jsou k tvorbě využity.

Videomontáže zřejmě zasahují do osobnostních práv poškozených, zatím ale není jasné, jak na tuto věc budou pohlížet soudy... |

Někteří řadi tato videa do stejné kategorie, jako tzv. „revenge porn“, kde je choulostivé video zveřejněno bez souhlasu zobrazené osoby. Ovšem v případě „deep fakes“ montáží jde dokonce o vytvoření tohoto videa bez souhlasu, a vytvoření takového videa je neskonale jednodušší, než bylo v minulosti. Podle některých právníků ale není jasné, jak bude soud tento typ montáží posuzovat. Existují paragrafy, které by se jich mohly týkat (například poškození dobrého jména, zásah do soukromí, zneužití osobních údajů), většina právníků se ale shoduje, nové „deep fakes“ montáže zcela nezapadají do žádné z nich.

Jak neuronová síť ohýbá realitu?

Proč se tato „deep fakes“ videa objevila právě teď? Dalo by se říci, že to souvisí s obecným rozvojem technik strojového učení, konkrétně rozmachem nástrojů k vývoji aplikací založených na trénování neuronových sítí.

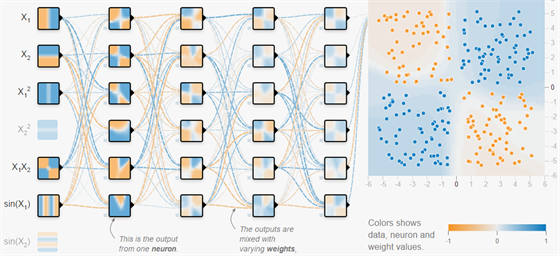

Co to je neuronová síť a jak se učíUmělá neuronová síť do jisté míry napodobuje způsob, jakým informace zpracovává lidský mozek Počítačem simulovaná struktura pro zpracování dat - tzv. neuronová síť nebo umělá neuronová síť - se inspirovala u anatomie lidského mozku. Skládá se obvykle z vrstev velkého množství „neuronů“, což je samostatná jednotka, která má vstupy a výstupy. Více takových neuronů a vrstev znamená síť náročnější na simulaci (je třeba velký výpočetní výkon). Neuronová síť se učí (trénuje) na základě vstupních (testovacích, trénovacích) dat a zpětné vazby. Neuronová síť může také „učit sama sebe“, což zjednodušeně znamená, že sama sobě dává otázku, na kterou zná správnou odpověď, a trénuje sama sebe tak dlouho, dokud tuto odpověď není schopna poskytnout s určitou spolehlivostí. Příkladem může být třeba neuronová síť učící se rozpoznávat obličeje, hrát poker, analyzovat rizika nebo překládat cizojazyčné texty. |

Neuronové sítě nejsou v oblasti manipulace s obrazem žádnými nováčky. Již v minulosti vědci ukázali několik způsobů, jak lze strojové učení využít k úpravě videa. V našem článku o budoucnosti manipulace s videem ze srpna 2017 jsme zmiňovali i tyto dva konkrétní projekty, na které deep fakes navazují.

Projekt vědců Face2Face ze Stanfordu (2016, PDF):

Syntetizace vědců z Washingtonské univerzity (2017, PDF):

Nově ale vtipálkům i manipulátorům stačí nainstalovat aplikaci „Fake App“, která se o manipulaci obrazu postará sama. Aplikace využívá několik známých metod strojové učení. Podle tvůrce aplikace (který zůstává v anonymitě) využívá dostupné open-sourcové knihovny pro strojové učení: Keras, TensorFlow nebo CUDA Toolkit. Podle jeho vlastních slov to „není nic složitého“. Využívá nicméně zajímavý fígl, jak podrobně vysvětluje třeba Siraj Raval, odborník na strojové učení.

Vysvětlení principu montáží „deepfakes“ (Siraj Raval, YouTube.com):

Přestože na první pohled se může zdát, že aplikace prostě hledá jeden obličej a nahrazuje jej druhým, skutečnost je o něco zajímavější. Aplikace má vlastně dvě části. Jedna část aplikace se vytrénuje v rozpoznávání konkrétního obličeje a jeho „rekonstrukci“ v případě obrazového poškození nebo neúplnosti.

K abstrakci algoritmus využívá histogram orientovaných gradientů, což se pak hodí i k nalepení oka na oko a brady na bradu. Tak lze získat dostatečně abstraktní pohled na lidskou tvář.

Druhá část aplikace se vytrénuje na obličeji cílové osoby, jejíž obličej má být nalepen přes obličej původní. Aplikace jakoby předpokládala, že na snímku osoby A byla ve skutečnosti osoba B, a opravuje tedy snímek osoby A podle snímků osoby B.

Nejsou použity konkrétní fotografie, jde o „počítačovou fantazii“ |

To znamená, že ve výsledném videu je celkem dobře zachován výraz obličeje. Je to zvláštní mix montáže, statistiky a něčeho, čemu se možná v budoucnu bude říkat „počítačová fantazie“.

Celý proces trénování a „opravování“ videa může i u krátkého klipu trvat i desítky hodin. Protože se neuronová síť učila ze stovek nebo tisíců fotek cílové osoby, jsou ve fotomontáži vidět reálné ekvivalenty úsměvu, údivu a dalších výrazů. Tím je videomontáž překvapivě realistická.

Postupně se začaly objevovat realističtější a realističtější montáže. Nejlépe si aplikace poradí s obličejem dívajícím se přímo do kamery. Naopak zvláštní pohyby hlavy, dlouhé vlasy před obličejem nebo netradiční úhly jsou pro tuto aplikaci problém.

Je to morální? Etické? Legální? Vzrušující? Nechutné?

Nyní se pornografické videomontáže deepfakes nacházejí na černé listině mnoha diskuzních serverů i videoserverů, právě proto, že jsou tak často pornografické, a to navíc využívající tělo pornohereček bez jejich svolení.

Bylo nicméně zajímavé sledovat, jak si diskutující - když zrovna nediskutovali o tom, kterou celebritu by měl někdo naroubovat na kterou pornoherečku - uvědomovali etický a distopický přesah těchto montáží. „Většina lidí to bere tak, že k tomu mají výhrady, ale jejich sexualita nad etikou převáží,“ popsal to pro The Verge diskutující deepfakes, který tuto lavinu spustil.

„Já sám mám v tomto ohledu trpím určitou kognitivní disonancí, která celou tuhle záležitost obklopuje,“ podotkl deepfakes pro Unilad. „Nikdy bych (takovouto pornografickou montáž) nemohl udělat na člověku, kterého znám v životě. Přijde mi nechutné o tom jenom přemýšlet. Když ale přijde na celebrity, takový pocit nemám. O těchto herečkách vím jen to, že je znám z filmů a že jsou velmi přitažlivé. Tak mi ta montáž nevadí.“

„To, co děláme, je ponižující a zákeřné vůči ženám, které k montážím využíváme...“ |

Jiný z uživatelů v (nyní již smazané) komunitě deepfakes uznal, že tyto videomontáže jsou problematické: „To, co tady děláme, není vznešené nebo etické. Je to ponižující, sprosté a zákeřné vůči ženám, které k montážím používáme.Tato technologie nemůže být odvynalezena. Jsem obhájcem té technologie, nikoli toho, k čemu je využívána.“ Vzápětí se ovšem pokusil o obhajobu tohoto jednání: „Tato technologie může pomoci obětem, jejichž nahé video uniklo na internet. Nyní totiž mohou říci, že se jedná o videomontáž. Když může být cokoli reálné, nic není reálné,“ dodal uživatel s přezdívkou Gravity_Horse.

Socioložka Katherine Crossová se domnívá, že jde v podstatě o výmluvu, jakousi morální kličku, která umožňuje pachatelům získat odstup od amorálnosti svého jednání: „Říkají, že to nikomu neubližuje, protože je to jenom hra a není to doopravdy. Ale pochopitelně mají pocit, že to tak trochu doopravdy je, dost na to, aby jim to přineslo vzrušení. Pornografické videomontáže jsou, když to řeknu natvrdo, masturbační pomůcky. A pokud jsou tyto videomontáže dostatečně realistické na to, aby tyto muže vzrušily, pak jsou dostatečně realistické na to, aby vadily lidem, které tyto videomontáže proti jejich vůli zobrazují.“ Připomíná, že ti, kterým nevadí montovat na fotky obličeje celebrit, by měli problém to samé udělat třeba s fotkami své sestry, čímž sami sebe usvědčují z pokrytectví.

„Můžete na tenhle (pornografický) videoklip namontovat holku, se kterou jsem chodil na střední?“ ptal se třeba jeden z diskutujících. „Mám její Facebook a Instagram.“ Zatímco někteří diskutující jej ignorovali nebo odmítli, jiní ochotně nabídli pomoc: „Stačí, když budeš mít tak stovku fotek, radši sto padesát.“

Zneužití nového druhu videomontáží na sebe určitě nenechá dlouho čekat. V oblasti pornografie lze předpokládat, že - podobně, jako v případě tzv. „revenge porn“ - objektem vyobrazení budou častěji ženy, a tedy že právě ženy budou častěji čelit negativním dopadům. Ovšem přesah techniky, která umí nahrazovat obličeje ve filmu, bude pravděpodobně mnohem větší.

Naučíme se nedůvěřovat videu?

Jak poznat fotomontáž? |

Etické dopady automatického montování obličejů do videa ale pochopitelně nemohou nástup této techniky zastavit. Stejně, jako jsme se museli naučit žít ve světě plném fotomontáží, budeme si muset zvyknout i na to, že i velmi realisticky vypadající video může být ve skutečnosti zfalšované. A že toto zfalšování nemusí být prodkuktem týmu odborníků na vizuální efekty, ale jen třeba hříčka znuděného puberťáka.

„Nic už nebudeme moci považovat za reálné,“ uvědomil si jeden z diskutérů v (dnes již zrušené) diskuzní komunitě, která byla povětšinou nadšená přílivem falešného porna. Začnou vznikat kompromitující materiály, materiály určené k vydírání, materiály určené k ponižování a dehonestaci osob. A ačkoli si budou diváci teoreticky uvědomovat, že vše může být zmanipulované, bude velmi těžké nevěřit věcem, které uvidíme na vlastní oči a uslyšíme na vlastní uši.

Prozatím lze videomontáže typu deepfakes s trochou snahy rozpoznat, ať už podle nepřirozených artefaktů na okraji obličeje, podivných „problikávajících“ výrazů nebo zkrátka nalezením podkladového materiálu (původního videa).

Video samo o sobě už nebude důkazem |

Přijde ale možná doba, kdy budou videomontáže - vyladěné pomocí automatických algoritmů strojového učení - tak levné a uvěřitelné, že přestane mít video důkazotvorný význam, který mu dnes připisujeme. Místo toho bude video spíše takovou pastelkou, kterou budeme moci kreslit různé vlastní verze reality.

Pravděpodobně pak nastoupí nové technologie, které budou naopak pravost videí zajišťovat a ověřovat. Vzniknou nové zákony, které budou upravovat svobodu montáže a chránit právo na podobu. A slavní herci budou pronajímat filmovým studiím svou podobu, zatímco na place se budou potit jejich méně slavní kolegové, jejichž tvář nakonec ve filmu neuvidíte.

Jsme připraveni? Nejspíše ne, ale zvykejme si. To, co se před několika lety řešilo čistě teoreticky, se stává velmi rychle realitou. Neuronové sítě se umí učit velmi rychle, a my se musíme pokusit držet s nimi krok.