Poslední rok se objevují různé demonstrace toho, co všechno dokáže strojové učení, konkrétně různé typy neuronových sítí. Tato práce kanadských vědců, publikovaná na platformě Arxiv (bez recenzního řízení), ovšem rozhodně patří mezi ty nejzábavnější.

Vědci využili generativních adversiálních sítí (GAN) k vytvoření tanečních videoklipů. Tanečníkem se přitom může stát kdokoli, stačí, když si obleče něco nepříliš vlajícího a je ochoten se necelou půlhodinu bezcílně natřásat před kamerou, aby se získal dostatek zdrojových dat.

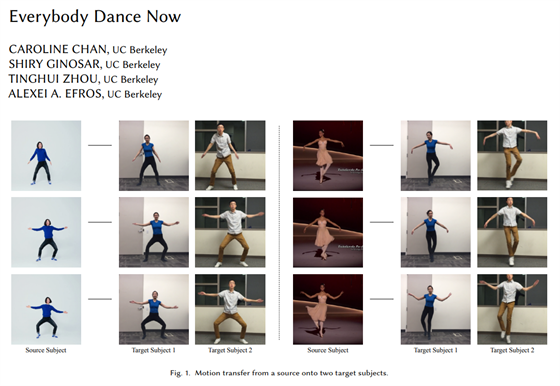

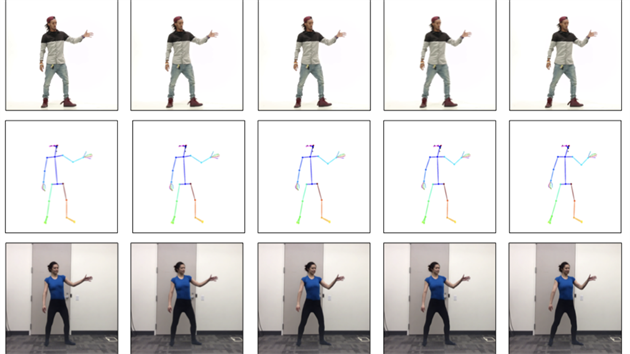

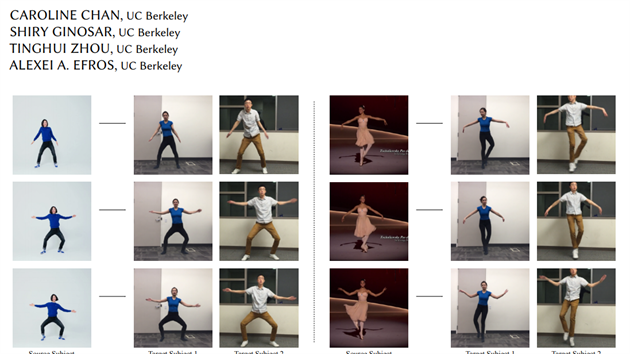

Pak už stačí vybrat zdrojový klip - tedy pokud možno klip, kde je dlouhý záběr na jednoho tanečníka nebo tanečnici - a série algoritmů vyvinutých čtyřčlenným týmem z UC Berkeley vytvoří výsledné video.

Everybody dance now (video UC Berkeley):

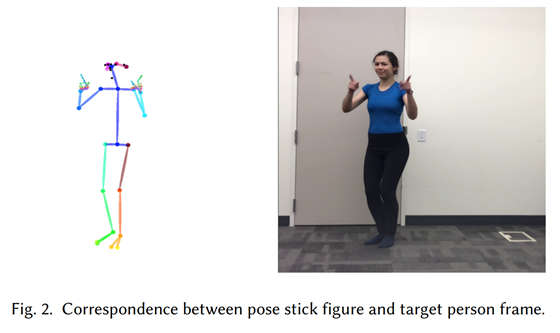

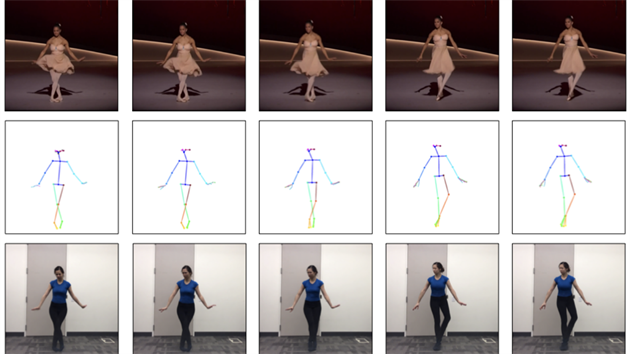

Systém má několik částí. Nejprve je potřeba detekovat pozici tanečníka, kterou je následně potřeba „sladit“ s ostatními okolními snímky, aby byl pohyb plynulý. Vědci k tomu přistoupili tak, že proti sobě postavili dvě neuronové sítě (proto ono „adversiální“, tedy nepřátelské). Jedna předpovídala pozici okolních snímků, druhá na základě naučených dat o pozicích odhadovala, zda je taková pozice reálná, nebo počítačem generovaná. Tím, jak se jedna síť snaží druhou oblafnout, dochází k učení a zdokonalování celého systému.

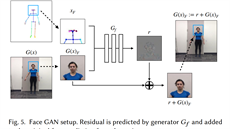

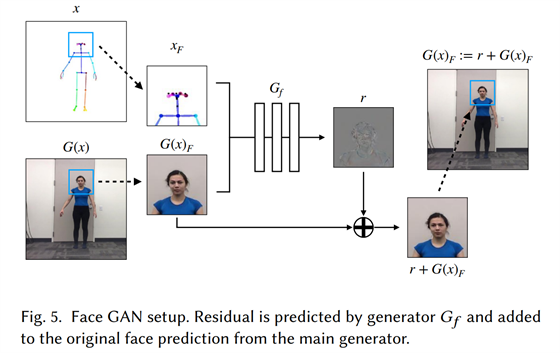

V další fázi je potřeba vzít data naučená z videa modelky a nasadit je na onu pozici, v podstatě obléci onu kostru. Tento transfer z kostry na kostru je dále doplněn ještě dodatečným nalepením vygenerovaného obličeje, kterému je věnována zvláštní péče, protože právě na obličeji jsou různé transformace pro diváka nejvíce rušivé.

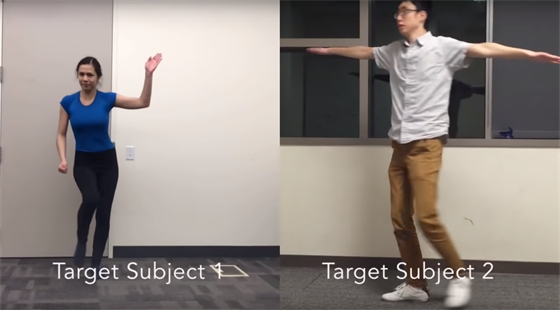

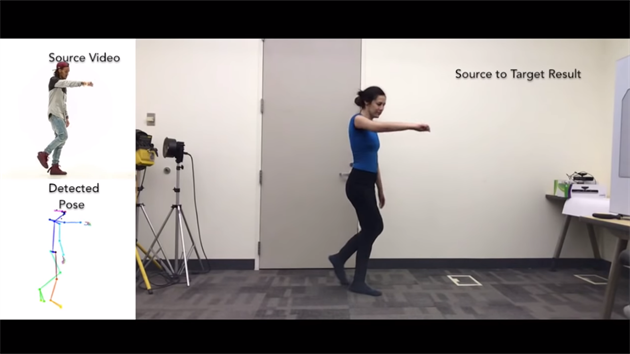

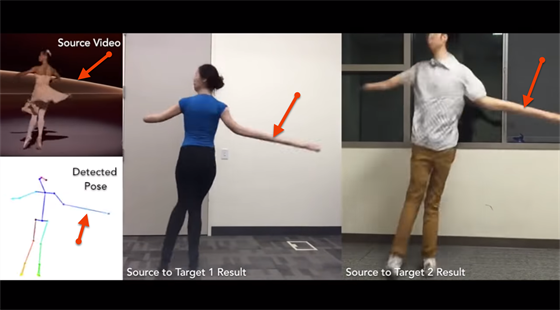

Výsledek samozřejmě zdaleka není dokonalý. Obličej je někdy nepřirozeně natažený nebo má nekorespondující výraz. Dobrým příkladem chyby je také následující snímek, který jsme ulovili ve zveřejněném ukázkovém videu:

Ukázka důsledku chybné detekce i toho, jak si s ní neuronová síť poradila. Na zdrojovém snímku splynula část pozadí s tím, kde má tanečnice svůj pravý loket. Počítač to vyhodnotil jako součást těla. Patřičně dlouhé předloktí pak vygeneroval i do videa obou cílových modelů. Chyba byla nejspíše umocněna „mezičlánkem“, algoritmem, který se stará o plynulost a návaznost snímků videa.

Celkově je však výsledek překvapivě plynulý, ačkoli se skutečnými záběry by si jej asi spletl jen někdo, kdo opravdu nedává pozor. Ale dokážeme si představit, že se tento nebo podobný algoritmus může uplatnit v zábavních aplikacích nebo počítačových hrách. A samozřejmě jde o další ukázku toho, jak nové technologie pomáhají stírat rozdíl mezi manipulací a realitou.

Další ukázky z práce Everybody dance now |

Po fotkách přijdou o důvěryhodnost i videa

To, že počítače umí generovat realisticky vypadající fotografie a videa, nepíšeme poprvé. Už v roce 2008 jsme otestovali počítačové zestárnutí, později jste si na Technetu mohli přečíst o fotomontážích budoucnosti. Psali jsme také o tom, jak fotomontáže fungují a jak je odhalit. Dokonce jsme sami několikrát odhalili fotomontáž nebo na nepřiznanou úpravu fotek upozornili.

Na to, že fotografie lze prostřednictvím grafického programu manipulovat („fotošopovat“), si lidé postupně celkem zvykli. Vědí, že lidé na obálkách magazínů nejsou ve skutečnosti tak hubení nebo svalnatí, jak vypadají.

V principu není video nic jiného, než série fotografií. Proto není nic nepochopitelného na tom, že pokud je možné manipulovat fotografie, je samozřejmě možné manipulovat i video. Ale protože i kraťoučké video obsahuje tisíce snímků, zvykli jsme si na to, že takové videomontáže jsou velmi drahé a náročné. U filmů se jim věnují týmy desítek i stovek expertů a filmové speciální efekty tradičně spolknou nemalou část rozpočtu. Ještě před patnácti lety bylo celkem ospravedlnitelné předpokládat, že amatérské video bude nejspíše pravé. Pouze profesionálové nebo opravdu trpěliví hračičkové dokázali vytvořit důvěryhodnou montáž. A jen ti nejlepší si troufli na něco takového, jako je náhrada obličeje na videu jinou tváří.

S nástupem chytrých nástrojů pro tvorbu videomontáží ovšem právě tyto - dříve nesmírně drahé - začínají být dostupné. V roce 2016 vědci ze Stanfordu ukázali svůj projekt Face2Face, který uměl nahradit jednu tvář druhou.

Ukázka systému Face2Face z roku 2016

Od té doby na tento projekt navázali další výzkumníci a na začátku roku 2018 internet zaplnily tzv. deep fakes - videomontáže vytvořené počítačem s využitím prvků strojového učení. O rozšíření pojmu se postarala především komunita vytvářející pornografické videomontáže, nicméně využití v propagandě nebo politice bylo jen otázkou času.

Jak fungují videomontáže deep fakes (reportáž Technet.cz)

Od té doby přišly nové studie ukazující, že pokroky v tvorbě videomontáží - zejména v generování realistických videí s použitím cizích obličejů - se dějí nejen na scéně internetových amatérů, ale i na scéně vědecké a profesionální. Samozřejmě, že je to stále začínající technologie a většinou na výsledku s trochou snahy poznáte, že jde o počítačově vyrenderovaný obraz. Ale i tak se experti domnívají, že tato technologie může časem představovat nebezpečí z hlediska soukromí i z hlediska národní bezpečnosti států.

Stejně jako u falešných zpráv u falešných videí hrozí, že se budou šířit rychleji, a to právě díky své překvapivosti. U fotografií nám trvalo dlouhá desetiletí, než jsme si (víceméně) zvykli na to, že to, co na obrázku vidíme, nemusí odpovídat realitě. Jak dlouho nám to bude trvat u videa?